[ad_1]

Nvidias Grafikkarten der RTX 40-Serie kommen in ein paar Wochen, aber unter all den Hardware-Verbesserungen könnte Nvidias goldenes Ei sein: DLSS 3. Es ist mehr als nur ein Update, ein Update von Nvidias beliebter DLSS-Funktion (Deep Learning Super Sampling). . , und es könnte am Ende die nächste Generation von Nvidia viel mehr definieren als die Grafikkarten selbst.

AMD hat hart daran gearbeitet, seine Superauflösung FidelityFX (FSR) auf Augenhöhe mit DLSS zu bringen, und in den letzten Monaten war es ein Erfolg. DLSS 3 scheint diese Dynamik zu ändern – und dieses Mal kann FSR möglicherweise nicht so schnell aufholen.

Wie DLSS 3 funktioniert (und wie nicht)

Es sei Ihnen verziehen zu denken, dass DLSS 3 eine völlig neue Version von DLSS ist, aber das ist es nicht. Oder zumindest ist es nicht ganz neu. Das Rückgrat von DLSS 3 ist die gleiche Super-Resolution-Technologie, die heute in DLSS-Titeln verfügbar ist, und Nvidia wird sie wahrscheinlich mit neuen Versionen weiter verbessern. Nvidia sagt, dass Sie den Super-Resolution-Teil von DLSS 3 jetzt als separate Option in den Grafikeinstellungen sehen werden.

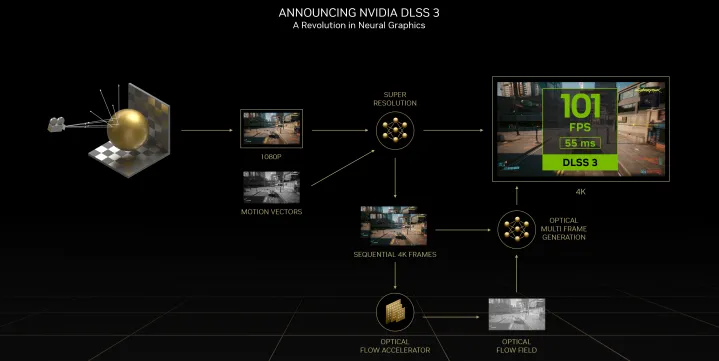

Der neue Teil ist die Frame-Generation. DLSS 3 generiert alle zwei Frames ein völlig einzigartiges Bild und generiert im Wesentlichen sieben von acht Pixeln, die Sie sehen. Eine Veranschaulichung dazu finden Sie im folgenden Flussdiagramm. Bei 4K rendert Ihre GPU nur die Pixel für 1080p und verwendet diese Informationen nicht nur für das aktuelle Bild, sondern auch für das nächste Bild.

Die Bilderzeugung wird laut Nvidia ein separater Wechsel von der Superauflösung sein. Dies liegt daran, dass die Frame-Generierung derzeit nur auf GPUs der RTX 40-Serie funktioniert, während Super Resolution weiterhin auf allen RTX-Grafikkarten funktioniert, auch in Spielen, die auf DLSS aktualisiert wurden. 3. Es sollte selbstverständlich sein, aber wenn die Hälfte von Ihre Bilder werden vollständig generiert, es wird Ihre Leistung steigern viel.

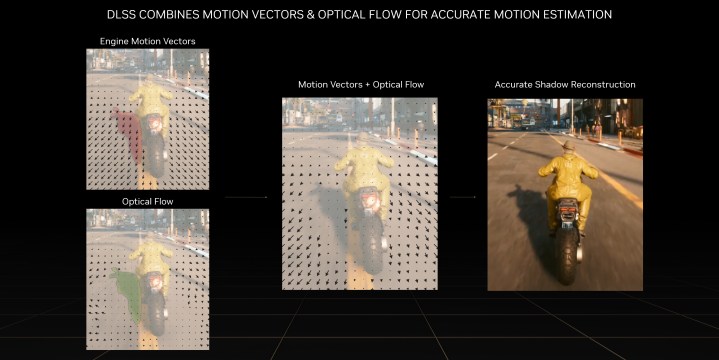

Die Frame-Generierung ist jedoch nicht nur eine geheime KI-Sauce. In DLSS 2 und Tools wie FSR sind Bewegungsvektoren eine wichtige Eingabe für die Skalierung. Sie beschreiben, wo sich Objekte von Frame zu Frame bewegen, aber Bewegungsvektoren gelten nur für die Geometrie einer Szene. Elemente ohne 3D-Geometrie, wie Schatten, Reflexionen und Partikel, wurden traditionell aus dem Skalierungsprozess maskiert, um visuelle Artefakte zu vermeiden.

Maskierung ist keine Option, wenn eine KI ein völlig einzigartiges Bild erzeugt, und hier kommt der optische Flussbeschleuniger der GPUs der RTX 40-Serie ins Spiel. Es ist wie ein Bewegungsvektor, außer dass die Grafikkarte die Bewegung einzelner Pixel von Frame zu Frame verfolgt . Dieses optische Flussfeld trägt zusammen mit Bewegungsvektoren, Tiefe und Farbe zum KI-generierten Frame bei.

Klingt nach allen Vorteilen, aber es gibt ein großes Problem mit KI-generierten Frames: Sie erhöhen die Latenz. Das von der KI generierte Bild durchläuft niemals Ihren PC – es ist ein „gefälschtes“ Bild, sodass Sie es nicht auf herkömmlichen fps-Anzeigen in Spielen oder Tools wie FRAPS sehen werden. Somit nimmt die Latenzzeit trotz der Anzahl zusätzlicher Frames nicht ab, und aufgrund des Rechenaufwands für den optischen Fluss nimmt die Latenzzeit tatsächlich zu. Aus diesem Grund benötigt DLSS 3 Nvidia Reflex, um die höhere Latenz zu kompensieren.

Normalerweise speichert Ihre CPU eine Render-Warteschlange für Ihre Grafikkarte, um sicherzustellen, dass Ihre GPU nie auf die Erledigung der Arbeit wartet (was zu Stottern und Framerate-Einbrüchen führen würde). Reflex entfernt die Render-Warteschlange und synchronisiert Ihre GPU und CPU, sodass die GPU mit der Verarbeitung beginnt, sobald Ihre CPU Anweisungen senden kann. Wenn es auf DLSS 3 angewendet wird, sagt Nvidia, dass Reflex manchmal sogar zu einer reduzierten Latenz führen kann.

Wo KI den Unterschied macht

AMDs FSR 2.0 verwendet keine KI, und wie ich vor einer Weile geschrieben habe, beweist es, dass Sie es können erhalten Sie die gleiche Qualität wie DLSS mit Algorithmen anstelle von maschinellem Lernen. DLSS 3 ändert dies mit seinen einzigartigen Frame-Generierungsfunktionen sowie der Einführung von Optical Flow.

Der optische Fluss ist keine neue Idee – er gibt es schon seit Jahrzehnten und findet Anwendung in allem, von Videobearbeitungs-Apps bis hin zu selbstfahrenden Autos. Jedoch, Berechnung des optischen Flusses mit maschinellem Lernen ist aufgrund einer Zunahme von Datensätzen, auf denen KI-Modelle trainiert werden können, relativ neu. Der Grund, warum Sie KI verwenden möchten, ist einfach: Sie erzeugt bei ausreichendem Training weniger visuelle Fehler und verursacht beim Laufen nicht so viel Overhead.

DLSS läuft zur Laufzeit. Es ist möglich, ohne maschinelles Lernen einen Algorithmus zu entwickeln, um abzuschätzen, wie sich jedes Pixel von Frame zu Frame bewegt, aber es ist rechenintensiv, was den Zweck des Oversamplings an erster Stelle zunichte macht. Mit einem KI-Modell, das nicht viel Leistung und genügend Trainingsdaten benötigt – und seien Sie versichert, Nvidia hat viele Trainingsdaten, mit denen Sie arbeiten können – können Sie einen qualitativ hochwertigen, skalierbaren optischen Fluss erreichen, der zur Laufzeit ausgeführt werden kann.

Dies führt zu einer verbesserten Framerate auch in CPU-begrenzten Spielen. Oversampling gilt nur für Ihre Auflösung, die fast ausschließlich von Ihrer GPU abhängt. Mit einem neuen Bild, das die CPU-Verarbeitung umgeht, kann DLSS 3 die Bildraten in Spielen verdoppeln, selbst wenn Sie einen vollen CPU-Engpass haben. Das ist beeindruckend und derzeit nur mit KI möglich.

Warum FSR 2.0 (noch) nicht aufholen kann

AMD hat mit FSR 2.0 wirklich das Unmögliche geschafft. Es sieht fantastisch aus und die Tatsache, dass es markenunabhängig ist, ist noch besser. Ich war bereit, DLSS für FSR 2.0 aufzugeben, seit ich es zum ersten Mal gesehen habe Todesschleife. Aber obwohl ich FSR 2.0 mag und denke, dass es ein großartiges Teil des Kits von AMD ist, wird es DLSS 3 in absehbarer Zeit nicht einholen.

Zunächst einmal ist die Entwicklung eines Algorithmus, der jedes Pixel zwischen Frames ohne Artefakte verfolgen kann, ziemlich schwierig, insbesondere in einer 3D-Umgebung mit feinen und dichten Details (Cyberpunk 2077 ist ein tolles Beispiel). Es ist möglich, aber schwierig. Das größere Problem ist jedoch, wie aufgeblasen dieser Algorithmus sein sollte. Jedes Pixel im 3D-Raum zu verfolgen, die Berechnung des optischen Flusses durchzuführen, ein Bild zu erzeugen und alle dabei auftretenden Pannen zu beseitigen – das ist eine Menge verlangt.

Es ist noch mehr zu verlangen, dass dies funktioniert, während ein Spiel läuft, während die Bildrate immer noch auf das Niveau von FSR 2.0 oder DLSS erhöht wird. Nvidia muss selbst mit dedizierten Prozessoren und einem trainierten Modell immer noch Reflex verwenden, um die durch den optischen Fluss verursachte höhere Latenz zu kompensieren. Ohne diese Hardware oder Software würde FSR wahrscheinlich zu viel Latenz opfern, um Frames zu generieren.

Ich habe keinen Zweifel, dass AMD und andere Entwickler irgendwann dorthin kommen werden – oder einen anderen Weg finden werden, um das Problem zu umgehen – aber es könnte ein paar Jahre dauern. Das ist jetzt schwer zu sagen.

Es ist einfach zu sagen, dass DLSS 3 sehr spannend klingt. Natürlich müssen wir warten, bis es verfügbar ist, um die Leistung von Nvidia zu validieren und zu sehen, wie sich die Bildqualität hält. Bisher haben wir nur ein kurzes Video von Digital Foundry, das DLSS 3-Material zeigt (oben), das ich sehr empfehlen kann, es sich anzusehen, bis wir weitere Tests von Drittanbietern sehen. Aus heutiger Sicht sieht DLSS 3 aber durchaus vielversprechend aus.

Dieser Artikel ist Teil von ReSpec – einer fortlaufenden zweiwöchentlichen Kolumne mit ausführlichen Diskussionen, Tipps und Berichten über die Technologie hinter PC-Spielen.

Empfehlungen der Redaktion

[ad_2]

Source