In einer zunehmend technologisierten Welt, in der Künstliche Intelligenz (KI) immer mehr Aufgaben übernimmt, kommt es leider auch immer wieder zu Fehlern. Ein aktuelles Beispiel zeigt, wie eine KI-basierte Nachrichtenfunktion von Apple eine falsche und potenziell gefährliche Schlagzeile verbreitete, die die BBC zu einer offiziellen Beschwerde veranlasste.

Was genau passierte?

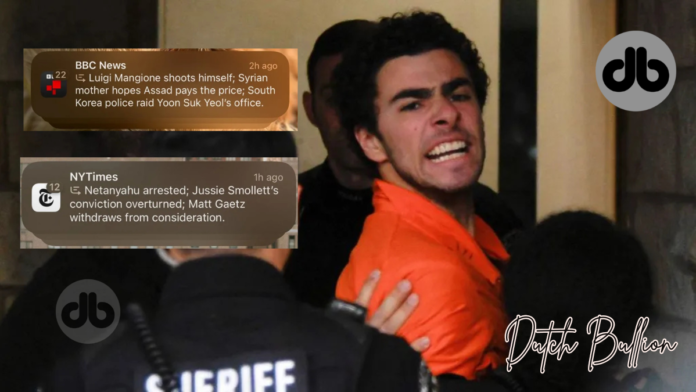

Am Anfang dieser Woche erlebten viele iPhone-Nutzer eine überraschende und gleichzeitig verwirrende Benachrichtigung: Die neue KI-Zusammenfassung auf iPhones, die von Apple im Rahmen des iOS 18.1-Updates eingeführt wurde, brachte eine falsche Schlagzeile der BBC auf ihren Bildschirm. Die Nachricht vermittelte den Eindruck, dass Luigi Mangione, der in den USA wegen des Mordes an Brian Thompson, dem CEO einer Krankenversicherung, festgenommen wurde, sich nach seiner Verhaftung selbst erschossen habe.

Was war das Problem mit der KI-Schlagzeile?

Die falsche Zusammenfassung kam durch die neue KI-gestützte Technologie von Apple zustande, die dazu dient, Nachrichten zu gruppieren und in einem einzigen Benachrichtigungs-Popup zusammenzufassen. Diese Zusammenfassungen sollen es den Nutzern ermöglichen, wichtige Informationen auf einen Blick zu erfassen und sich nicht durch eine Vielzahl an Einzelbenachrichtigungen gestört zu fühlen.

In diesem Fall aber war der Fehler in der Zusammenfassung der Nachricht von der BBC offensichtlich. Die KI zog falsche Schlüsse aus dem Originalartikel und kombinierte ihn mit anderen Informationen auf eine Weise, die falsche Implikationen schuf. In der Zusammenfassung wurde fälschlicherweise behauptet, dass Mangione sich das Leben genommen habe – ein Ereignis, das in der ursprünglichen BBC-Meldung überhaupt nicht erwähnt wurde.

Warum ist dieser Fehler problematisch?

Die Verbreitung von Fehlinformationen durch KI kann weitreichende Konsequenzen haben. Gerade im Fall von Nachrichten, die mit kriminellen Vorfällen oder Sensationsmeldungen zu tun haben, können falsche Aussagen das Vertrauen der Öffentlichkeit in etablierte Medien wie die BBC beeinträchtigen. In diesem Fall hätte der Fehler zu massiver Verwirrung führen können, insbesondere weil die KI-Technologie viele Menschen dazu bringt, Nachrichten ohne tiefere Recherche oder Reflexion zu konsumieren.

In einem Kommentar erklärte ein Sprecher der BBC, dass der Vorfall ernst genommen werde und dass man bereits Kontakt zu Apple aufgenommen habe, um das Problem zu lösen. Die BBC betonte, dass es von entscheidender Bedeutung sei, dass ihr Publikum den veröffentlichten Informationen vertrauen kann – und dazu gehören auch Benachrichtigungen.

Weitere Fehler durch Apples KI-Technologie

Dies war jedoch nicht der einzige Vorfall, bei dem Apples neue KI-Zusammenfassungsfunktion für Aufsehen sorgte. Nur kurze Zeit später wurde ein weiterer Fehler entdeckt, als eine Benachrichtigung der New York Times über den israelischen Premierminister Benjamin Netanjahu fälschlicherweise die Nachricht von seiner Festnahme anzeigte, während es sich in Wirklichkeit nur um den Erlass eines Haftbefehls handelte.

Diese Fehler werfen Fragen auf, wie gut Apples KI-Algorithmus entwickelt wurde und ob die Technologie wirklich in der Lage ist, Nachrichten korrekt und ohne Fehler zu filtern. Derartige Fehlinformationen können nicht nur das Vertrauen in Nachrichtenquellen untergraben, sondern auch zu Verwirrung und Fehlinterpretationen in der Öffentlichkeit führen.

Warum ist KI im Journalismus problematisch?

Künstliche Intelligenz wird zunehmend im Journalismus eingesetzt, um Nachrichten zu filtern, zu ordnen und zu verbreiten. Die Automatisierung von Nachrichten bietet viele Vorteile, wie eine schnellere Verbreitung und personalisierte Inhalte. Doch das Beispiel von Apple zeigt, dass KI-Systeme noch nicht ausgereift sind, um die Komplexität menschlicher Sprache und Nuancen vollständig zu verstehen.

Der Fall mit der BBC und Apple zeigt auf, wie gefährlich es sein kann, wenn eine automatisierte Technologie unreflektiert in den Nachrichtenprozess eingreift. KI kann zwar dabei helfen, Nachrichten zu aggregieren und zusammenzufassen, aber sie kann auch kritische Fehler machen, die nicht sofort erkannt werden. In diesem Fall wurde eine falsche Behauptung über einen Mord verbreitet, was zu einer potenziellen Fehlinformation führte.

Apples Reaktion auf den Vorfall

Apple hat bislang noch keine detaillierte Stellungnahme zu den Vorfällen abgegeben. Es ist jedoch bekannt, dass Apple den Benutzern die Möglichkeit gibt, Fehler in ihren Benachrichtigungen zu melden. Zudem können sie die KI-Zusammenfassungsfunktion jederzeit deaktivieren, um die klassische Art der Benachrichtigung zu erhalten.

Trotz dieser Möglichkeiten wirft der Vorfall ein dunkles Licht auf die Technologie von Apple. Experten, wie der Medienwissenschaftler Professor Petros Iosifidis von der City University of London, bezeichneten den Fehler als „peinlich“ und warnten davor, dass eine Technologie, die nicht richtig funktioniert, gefährlich für die Medienlandschaft sein kann.

Die Folgen für das Vertrauen in Nachrichtenquellen

Was macht diesen Fehler so gravierend? Nachrichtenquellen wie die BBC genießen weltweit hohes Vertrauen. Ein solcher Vorfall kann das Vertrauen der Öffentlichkeit in etablierte Medien beeinträchtigen, da die Nutzer nun möglicherweise die Zuverlässigkeit von Nachrichten, die sie über Apple’s KI erhalten, in Frage stellen.

Darüber hinaus könnte dieser Fehler auch das Vertrauen in die neue Technologie von Apple untergraben. Wenn die KI in so wichtigen Bereichen wie der Nachrichtenverbreitung Fehler macht, stellt sich die Frage, wie zuverlässig diese Technologien in anderen Bereichen sind.

Was können wir aus diesem Vorfall lernen?

- Fehler in der KI sind unvermeidlich, aber sie müssen ernst genommen werden: Die Technologie ist noch nicht ausgereift, und Unternehmen wie Apple müssen sicherstellen, dass ihre Systeme regelmäßig überprüft und verbessert werden, um Fehler wie diesen zu vermeiden.

- Das Vertrauen in Medien ist entscheidend: Medienhäuser wie die BBC sind auf das Vertrauen ihrer Leser angewiesen. Ein Fehler wie dieser kann dieses Vertrauen gefährden, insbesondere wenn die Technologie für die Verbreitung von Informationen verantwortlich ist.

- Automatisierung muss mit Vorsicht eingesetzt werden: KI kann eine wertvolle Hilfe sein, aber sie sollte nicht unkritisch eingesetzt werden. Ein automatisiertes System muss in der Lage sein, zwischen verschiedenen Arten von Nachrichten zu unterscheiden und Kontext zu verstehen.

Häufig gestellte Fragen (FAQs)

Warum hat die KI von Apple die falsche Schlagzeile erstellt?

Die KI-gestützte Zusammenfassung von Apple hat Nachrichtenartikel kombiniert und dabei Fehler gemacht, was zu einer verzerrten Darstellung der Fakten führte. In diesem Fall wurde eine falsche Behauptung über Luigi Mangione erzeugt.

Kann ich die KI-Zusammenfassung auf meinem iPhone deaktivieren?

Ja, Apple bietet die Möglichkeit, die KI-Zusammenfassungen in den Einstellungen zu deaktivieren, wenn Nutzer lieber auf herkömmliche Weise benachrichtigt werden möchten.

Wie reagierte die BBC auf den Fehler?

Die BBC trat schnell mit Apple in Kontakt, um das Problem zu lösen und sicherzustellen, dass solche Fehler in der Zukunft nicht mehr auftreten.

Was sind die Risiken von KI im Journalismus?

KI im Journalismus kann zwar Nachrichten schneller verbreiten, aber sie birgt auch die Gefahr, Fehlinformationen zu verbreiten, da sie den Kontext oder die Nuancen der Inhalte oft nicht richtig erfasst.

Wie kann Apple solche Fehler in der Zukunft verhindern?

Apple müsste die KI-Systeme besser trainieren, um sicherzustellen, dass sie Nachrichten genau und im richtigen Kontext zusammenfassen. Regelmäßige Qualitätsprüfungen und Zusammenarbeit mit Medienhäusern könnten helfen, solche Fehler zu vermeiden.